該論文發(fā)表于IEEE Transactions on Neural Networks and Learning Systems(中科院1區(qū),,IF=9.6),,題目為《Hybrid Network Using Dynamic Graph Convolution and Temporal Self-Attention for EEG-Based Emotion Recognition》。

大連理工大學(xué)計算機(jī)科學(xué)與技術(shù)學(xué)院的程成博士為此論文的第一作者,,大連理工大學(xué)計算機(jī)科學(xué)與技術(shù)學(xué)院馮林教授為此論文的通訊作者,。

論文鏈接:https://ieeexplore.ieee.org/abstract/document/10285039

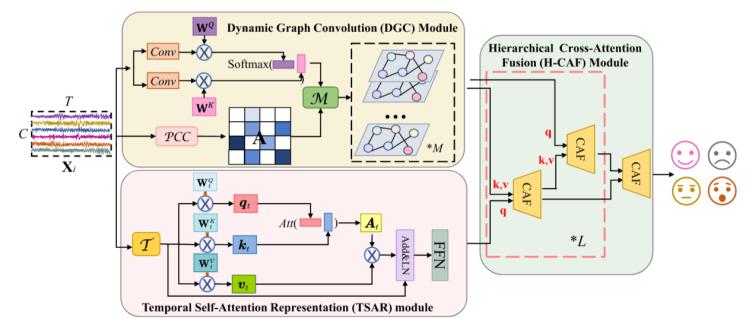

腦電圖(EEG)信號因其空間拓?fù)浜蜁r間依賴特性,,已成為情感識別的有效解碼目標(biāo),吸引了眾多研究者的關(guān)注,。然而,,現(xiàn)有研究往往只關(guān)注EEG信號的空間或時間特征,忽視了兩者的聯(lián)合考慮,。為此,,本文提出了一種混合網(wǎng)絡(luò),包含動態(tài)圖卷積(DGC)模塊和時間自注意力表示(TSAR)模塊,,能夠同時將空間拓?fù)浜蜁r間上下文信息融入EEG情感識別任務(wù)中,。具體而言,DGC模塊通過在模型訓(xùn)練過程中動態(tài)更新鄰接矩陣來捕捉大腦內(nèi)的空間功能關(guān)系,;TSAR模塊則用于強(qiáng)調(diào)更有價值的時間段,,并從EEG信號中提取全局時間特征。此外,,為了充分利用空間和時間信息之間的交互性,,本文還引入了層次交叉注意力融合(H-CAF)模塊,以融合空間和時間特征的互補信息,。在DEAP,、SEED和SEED-IV數(shù)據(jù)集上的大量實驗結(jié)果表明,所提出的方法優(yōu)于其他最先進(jìn)的方法,。

研究背景

情感是人類日常生活和人際交往中的重要組成部分,,隨著社交媒體數(shù)據(jù)的爆發(fā)式增長,開發(fā)自動情感識別系統(tǒng)對于提高情感理解的準(zhǔn)確性和效率變得至關(guān)重要,。EEG信號作為一種典型的生物電信號,,因其能夠記錄與情緒密切相關(guān)的大腦活動,已成為情感識別的重要研究對象,。然而,,EEG信號具有復(fù)雜的空間拓?fù)浣Y(jié)構(gòu)和時間依賴性,這使得同時提取其空間和時間特征成為一項挑戰(zhàn),。傳統(tǒng)方法主要依賴于手動提取淺層特征,,但這些方法需要豐富的先驗知識且難以處理大規(guī)模數(shù)據(jù),。近年來,深度學(xué)習(xí)方法,,尤其是卷積神經(jīng)網(wǎng)絡(luò)(CNN)和圖卷積網(wǎng)絡(luò)(GCN),,被廣泛應(yīng)用于EEG信號的空間特征提取,顯著提升了情感識別的性能,。然而,,許多現(xiàn)有研究僅關(guān)注EEG信號的空間或時間特征,而忽略了兩者的聯(lián)合考慮,。因此,,如何設(shè)計一個能夠同時有效表達(dá)和整合EEG信號空間和時間特征的模型,已成為EEG情感識別領(lǐng)域的一個重要挑戰(zhàn),。

方法與結(jié)果分析

本文提出了一種基于動態(tài)圖卷積(Dynamic Graph Convolution, DGC)和時間自注意力表示(Temporal Self-Attention Representation, TSAR)的混合網(wǎng)絡(luò)(Hybrid Network, HN-DGTS),,用于基于EEG的情感識別。該方法的核心在于同時提取EEG信號的空間和時間特征,,并通過層次交叉注意力融合(Hierarchical Cross-Attention Fusion, H-CAF)模塊進(jìn)行特征融合,,以提高情感識別的準(zhǔn)確性。

1. 特征構(gòu)建

設(shè)每個樣本的EEG信號為S = { (Xi , Yi),,i = 1,2,..,N },,其中Xi∈RC × T × F為一個三維矩陣,表示經(jīng)過C通道,、T個時間采樣點,、F個頻段預(yù)處理后的EEG樣本的第i個試次。N表示EEG試驗的總次數(shù),。在整個框架中,,將提取的DE特征圖作為HN - DGTS模型的輸入,大小表示為[N,C,D,F],。D表示從Xi中提取DE后得到的特征維數(shù),。隨后,我們將每個頻段作為模型的輸入,,記為X f∈RN × C × D。

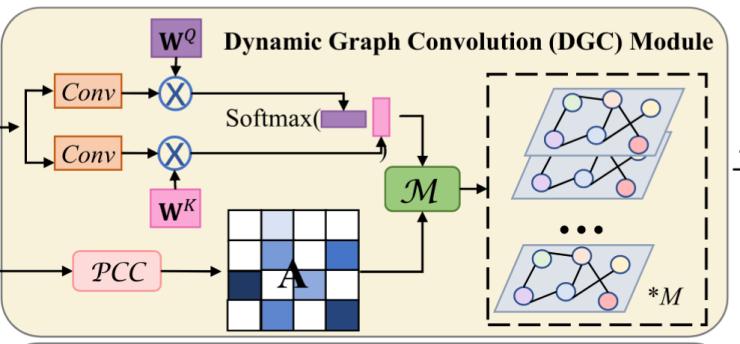

1.1 動態(tài)圖卷積(DGC)模塊

由于大腦的結(jié)構(gòu)和功能連接對于探索電極的相對空間結(jié)構(gòu)和解碼EEG信號所誘發(fā)的響應(yīng)具有重要意義,,因此預(yù)處理后的EEG信號最初被劃分為若干個不重疊的時間片段,,每個時間片段的持續(xù)時間為t s。隨后,,提取DE特征來構(gòu)建每個時間窗口的功能腦網(wǎng)絡(luò),。

A. 構(gòu)建鄰接矩陣

該網(wǎng)絡(luò)選擇PCC來模擬腦功能連接矩陣。對于每個頻段的一個樣本可以得到鄰接矩陣,,將每個頻段的所有EEG樣本計算得到的鄰接矩陣進(jìn)行組合,,生成對稱連接矩陣Af∈RN×C×C,。為了增強(qiáng)腦圖的泛化能力,Af被用來進(jìn)一步計算拉普拉斯矩陣L,。

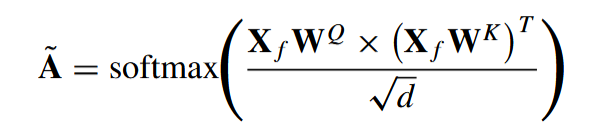

在大腦圖的基礎(chǔ)上,,論文中提出了一種新的方法來強(qiáng)調(diào)相鄰節(jié)點之間的關(guān)系,稱為自注意力機(jī)制,。該機(jī)制為圖中的所有邊分配權(quán)重,,使得模型能夠有效地處理來自不同表示子空間的信息,并以端到端的方式進(jìn)行學(xué)習(xí),。該公式可表示為如下形式:

式中:WQ和WK為線性投影參數(shù),,將輸入Xf投影到d維的輸出,√d為縮放因子,。A′中的每一個aij表示從通道i到通道j的歸一化權(quán)重,。由此,我們得到與不同腦電電極采集到的特征相關(guān)的注意力矩陣,。

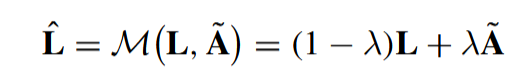

由于式中的A′涉及自注意力獲取的節(jié)點權(quán)重關(guān)系,,為了進(jìn)一步提高EEG信號的表征能力,將A′應(yīng)用于Laplacian矩陣L,。其過程可以表示為

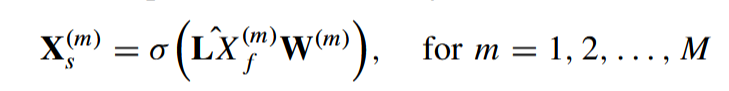

B.圖卷積操作

給定一個拉普拉斯矩陣L (和特征矩陣Xf),,在DGC模塊中,DGC作用于每個腦圖的節(jié)點以捕獲空間特征,,然后通過堆棧構(gòu)建多個卷積層,。在M層DGC中,第m層的圖卷積操作可以定義為

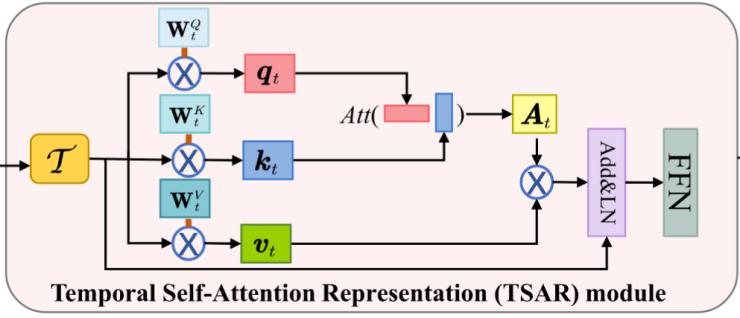

1.2 時間自注意力表示(TSAR)模塊

EEG信號的不同時間段相互關(guān)聯(lián),,每個時間段對情緒識別任務(wù)的貢獻(xiàn)不同,。為了注意到更有價值的時間片段信息,需要感知EEG信號的全局時間依賴關(guān)系,,并通過自注意力機(jī)制為更有用的時間片段分配更高的分?jǐn)?shù),。

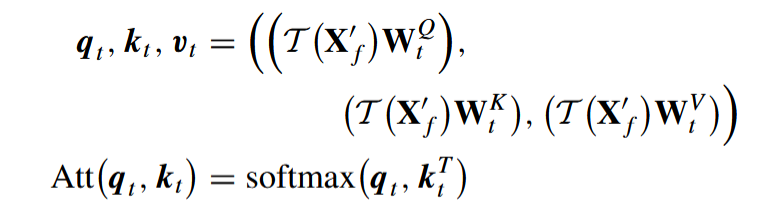

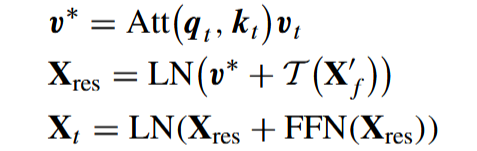

具體來說,EEG信號表示為X f∈RN × C × D,。為了捕獲時間依賴關(guān)系,,應(yīng)用變換操作來獲得潛在的時間特征,從而得到X’f∈RN × D × C,。隨后,,這些特征X’f經(jīng)過線性變換后被用作查詢( qt )、密鑰( kt )和值( vt ),。然后通過帶鍵的點積處理查詢,,接著通過softmax層生成每個值的代表性得分。全通道典型得分矩陣的計算過程描述如下:

給定所有通道的典型得分矩陣Att,,將每個值與可用信息進(jìn)行聚合以更新自身,。為了解決梯度消失問題,,加入了殘差連接。此外,,將自注意力與包含兩個全連接層和ReLU激活函數(shù)層的前饋網(wǎng)絡(luò)( FFN )相結(jié)合,。這種結(jié)合允許進(jìn)一步提取時序特征,增強(qiáng)了模型的非線性學(xué)習(xí)能力,。最終得到的時序特征Xt,,其大小與輸入相同,形狀為[N,D,C],。過程定義如下:

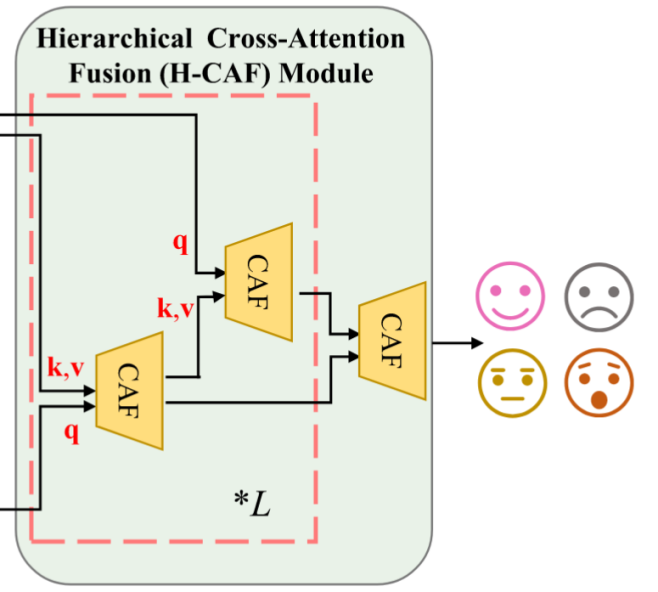

1.3 層次交叉注意力融合(H-CAF)模塊

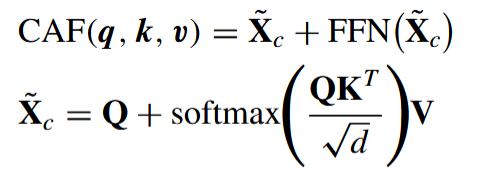

通過上述步驟,,我們得到了空間特征Xs和時間特征Xt。H - CAF旨在利用不同模態(tài)特征之間的互補信息,,使我們能夠提取更具代表性的特征,,并將其跨層充分融合,以增強(qiáng)預(yù)測能力,。通過該模塊的學(xué)習(xí)權(quán)重,,每個模態(tài)的注意力權(quán)重由另一個模態(tài)引導(dǎo),有效地利用了時空特征的互補性,。如圖中紅色虛線框所示,,兩個CAF形成了一層H - CAF。CAFs采用全交叉注意力結(jié)構(gòu)代替自注意力層,,具體可定義如下:

其中Q是CAF的q輸入,,K和V分別是CAF的k和v輸入,其中K和V相同,。

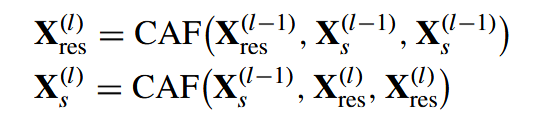

在H - CAF模塊中,,其中一個CAF接收來自一個分支的特征作為輸入,并使用來自另一個分支的特征作為鍵和值,。相反,,另一個CAF將上一個CAF收到的輸入作為key和value,而將上一個CAF的key和value作為當(dāng)前的輸入,。兩個CAFs構(gòu)成一層H - CAF,,其具體形式如下:

其中l(wèi) = ( 1 , 2 , ... , L)表示H - CAF模塊的層數(shù),l - 1表示前一層,,l表示當(dāng)前層,。這種層次化的方法使得H - CAF能夠充分利用每一層不同分支的互補信息來構(gòu)建情感相關(guān)的時空特征Xst∈RN × C × D。

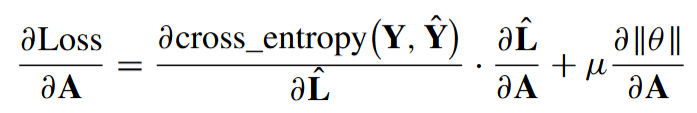

A. 后向更新鄰接矩陣

在提出的模型中,,使用交叉熵?fù)p失函數(shù)來衡量真實標(biāo)簽Yi和預(yù)測標(biāo)簽Y ( i之間的差異,并通過后向傳播來更新鄰接矩陣,。更新過程可以描述如下:

其中θ為訓(xùn)練過程中模型中的所有參數(shù),,∥·∥表示防止過擬合的正則化項,,μ為常數(shù)。

然后,,該模型可以更新鄰接矩陣A如下:

實驗結(jié)果

本文通過在三個公開的EEG情感識別數(shù)據(jù)集(DEAP,、SEED和SEED-IV)上進(jìn)行實驗,驗證了所提出的混合網(wǎng)絡(luò)(HN-DGTS)模型的有效性,。

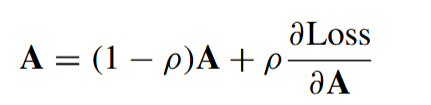

1. 消融實驗

通過消融實驗驗證了所提出的混合網(wǎng)絡(luò)(HN-DGTS)模型中各個模塊的貢獻(xiàn),。

DGC模塊:單獨使用DGC模塊時,分類準(zhǔn)確率較低,,表明僅依靠空間特征難以有效識別情感,。

TSAR模塊:單獨使用TSAR模塊時,分類準(zhǔn)確率高于DGC模塊,,但低于完整的HN-DGTS模型,,表明時間特征對情感識別有重要貢獻(xiàn)。

HN-DGTS模型:結(jié)合DGC和TSAR模塊,,并通過H-CAF模塊進(jìn)行特征融合,,模型的分類準(zhǔn)確率顯著提高,證明了空間和時間特征的聯(lián)合提取和融合對情感識別的重要性,。

圖1 三個數(shù)據(jù)集中不同配置設(shè)置的平均準(zhǔn)確率

DEAP - A表示DEAP中的喚醒維度,。DEAP - V表示DEAP中的效價維度,( a ) DEAP-A,,( b ) DEAP-V,,( c ) SEED,( d ) SEED - IV,。

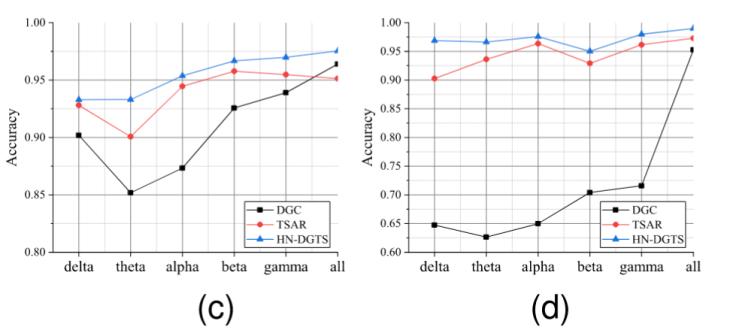

2. 實驗結(jié)果與分析

DEAP數(shù)據(jù)集:在喚醒度維度上,,β頻段的分類準(zhǔn)確率最高,達(dá)到89.44%,;在效價維度上,,γ頻段的分類準(zhǔn)確率最高,達(dá)到89.98%,??傮w來看,效價維度的分類準(zhǔn)確率高于喚醒度維度,,這與先前的研究結(jié)果一致,,表明效價對情感刺激更為敏感。

SEED數(shù)據(jù)集:在θ頻段上,,HN-DGTS模型的平均分類準(zhǔn)確率達(dá)到97.53%,;模型在積極和中性情感的分類上表現(xiàn)優(yōu)異,準(zhǔn)確率分別為96.67%和92.68%。

SEED-IV數(shù)據(jù)集:在θ頻段上,,HN-DGTS模型的平均分類準(zhǔn)確率達(dá)到98.97%,。模型在中性和悲傷情感的分類上表現(xiàn)最佳,準(zhǔn)確率分別為95.24%和98.48%,。

表1 在三個數(shù)據(jù)集的六個頻段上的平均分類精度

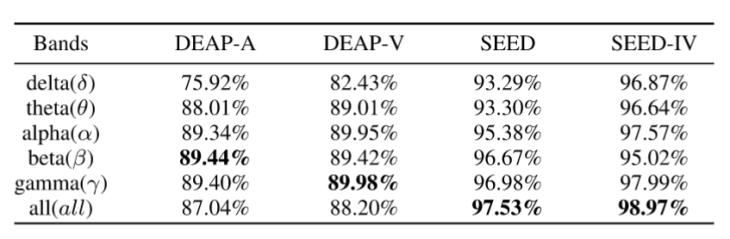

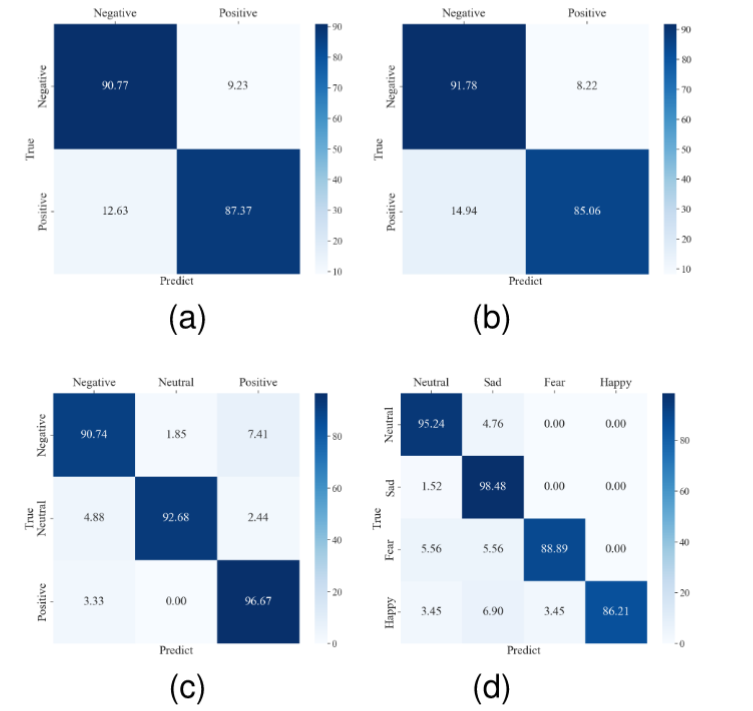

3. 混淆矩陣可視化

作者通過混淆矩陣對模型在不同數(shù)據(jù)集上的分類性能進(jìn)行了可視化分析,。混淆矩陣是一種用于評估分類模型性能的表格,,其中每一行代表實際類別,,每一列代表預(yù)測類別?;煜仃嚳梢灾庇^地展示模型對每個類別的分類準(zhǔn)確性和混淆情況,。

通過混淆矩陣的可視化,可以直觀地評估模型在不同情感類別上的分類性能,。本文提出的HN-DGTS模型在DEAP,、SEED和SEED-IV數(shù)據(jù)集上均表現(xiàn)出色,尤其是在識別低喚醒度,、低效價,、積極、中性和悲傷情感時,。這些結(jié)果進(jìn)一步驗證了模型在EEG情感識別任務(wù)中的有效性和魯棒性,。

圖 2 HN - DGTS的混淆矩陣

( a ) DEAP數(shù)據(jù)集的喚醒度混淆矩陣。( b ) DEAP數(shù)據(jù)集效價維度上的混淆矩陣,。( c ) SEED數(shù)據(jù)集上的混淆矩陣,。( d ) SEED - IV數(shù)據(jù)集上的混淆矩陣。

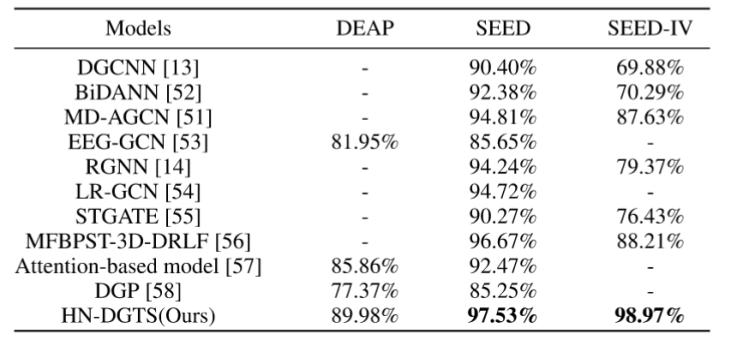

4. 與現(xiàn)有方法的比較

本文提出的HN-DGTS模型在DEAP,、SEED和SEED-IV數(shù)據(jù)集上的表現(xiàn)均優(yōu)于現(xiàn)有的先進(jìn)方法,。這些結(jié)果驗證了HN-DGTS模型在基于EEG的情感識別任務(wù)中的優(yōu)越性能,特別是在提取和融合空間與時間特征方面的能力,。

表2 與最新的相關(guān)研究結(jié)果進(jìn)行比較

結(jié)論

本文提出了一種混合網(wǎng)絡(luò)(HN-DGTS)模型,,用于基于腦電圖(EEG)的情感識別。該模型結(jié)合了動態(tài)圖卷積(DGC)模塊和時間自注意力表示(TSAR)模塊,,通過層次交叉注意力融合(H-CAF)模塊對空間和時間特征進(jìn)行融合,,從而充分利用EEG信號的空間拓?fù)浜蜁r間依賴性。實驗結(jié)果表明,,HN-DGTS模型在DEAP,、SEED和SEED-IV數(shù)據(jù)集上的性能均優(yōu)于現(xiàn)有的先進(jìn)方法,證明了其在EEG情感識別任務(wù)中的有效性和優(yōu)越性,。

撰稿人:吳旻津

審稿人:邱麗娜